-

Google I/O 2019 들여다보기Analysis 2019. 5. 10. 22:37

Google I/O 2019 Social Logo Google I/O는 매년 열리는 구글의 개발자 대상 컨퍼런스이다. 2008년부터 시작된 이 행사는 전 세계의 개발자들이 주목하는 컨퍼런스 중 하나가 되었다. Google I/O에서 I/O의 의미는 "Input/Output"을 뜻하기도 하고, "Innovation in the Open"을 뜻하기도 한다. Google I/O는 소프트웨어나 하드웨어 둘 중 하나에 집중하는 형태로 이루어져 왔는데, Google I/O 2019에서는 2018년에 비해 더 많은 하드웨어 제품이 소개되었다. 다음은 Google I/O의 키노트 영상이다.

그럼 이제부터 Google I/O에서 소개된 내용들 중 흥미있는 항목들에 대해 크게 하드웨어와 소프트웨어로 나누어 알아보겠다.

Hardware

Pixel 3a and 3a XL

Pixel 3a in 3 colors 구글은 I/O 당일부터 Pixel 3a와 3a XL의 판매를 시작한다고 발표했다. 특장점으로 강조한 것은 우선 3가지 색으로 나온다는 점이었고 "보라색 같은" 색깔이 추가되었음을 특히 강조하였다. 또, 아이폰에서 촬영한 야간사진과 비교하여 Pixel 3a의 사진이 더 선명함을 보여주는 비교 슬라이드를 띄웠다. 그리고 오디오잭이 있다는 점도 장점으로 언급하였다. 사실상 그렇게 큰 장점들은 아니었고, 공개된 외관의 모양도 하이엔드 안드로이드폰들에 비하면 크게 나은 점이 없어 보였다.

가장 흥미있는 부분은 399불부터 시작하는 판매가격이었다. 거의 중국 브랜드 수준의 가격을 책정한 것이다. 구글은 싼 가격의 이유로 방수 기능이나 무선충전 같은 기능들을 제공하지 않는다는 점을 들었다. 대신 클라우드의 Google Photo 저장 공간을 무료로 준다고 발표하였지만, 이마저도 원본 해상도가 아닌 좋은 화질의 해상도로만 이용할 수 있다고 발표하였다.

3a와 3a XL은 화면크기와 배터리 사이즈를 제외하면 거의 동일한 하드웨어 스펙을 갖추고 있다. 하지만 XL이 479불부터 시작하기에 판매 가격은 80불 정도 차이가 난다. 스펙 차이로만 보면 이해하기 힘든 가격 격차인데, 구글이 하드웨어 제조 및 판매에서는 그리 스마트하지 못한 모습을 보여주는 것 같다.

Pixel 3a Pixel 3a XL Display 5.6 inch gOLED

2,200 x 1,080

18.5:9 aspect ratio

6 inch gOLED

2,160 x 1,080

18:9 aspect ratio

Battery 3,000 mAh 3,700 mAh Dimensions and Weight 151.3 x 70.1 x 8.2 mm

147g

160.1 x 76.1 x 8.2mm

167g

종합적으로 볼 때, 구글이 제공하는 소프트웨어 업데이트를 제일 먼저 받을 수 있다는 장점을 제외하면, Pixel 3a/3a XL은 중국산 저가형폰에 준하는 가치를 가진다고 보인다.

Nest Hub (Max)

Nest Hub Max Nest Hub는 구글 Home Hub 제품의 새로운 이름이다. 기존과 같이 거실에서 허브 기능을 수행하는 장치이다. 전작과 마찬가지로 오디오 위주의 AI 스피커의 답답함을 해결하기 위한 대화면의 디스플레이 탑재가 특징적으로 다가온다. Nest Hub는 7인치의 스크린을 가지고 있고, Nest Hub Max는 무려 10인치의 스크린을 자랑한다. 가격은 229불부터 시작되며 7월부터 판매 예정이다.

Nest Hub에서 강조된 특징은 전면에 카메라를 탑재하고 있다는 점이다. 얼굴인식을 통해 가족 구성원 개개인에 최적화된 경험을 제공하기 위함이라고 발표했다. 프라이버시 문제를 의식한 것인지 AI관련 연산이 서버가 아닌 단말 내부에서 이루어진다고 언급했다. 얼굴 인식 데이터가 인터넷으로 전송되지 않음을 강조한 것이다. 또한 카메라가 작동되면 하드웨어적으로 LED가 점등된다. 카메라를 끄는 물리 버튼이 따로 존재하여 버튼을 끌 경우, 카메라 모듈에 전원이 공급되지 않는다는 점도 소개되었다.

거실에서 사용하는 패밀리 디바이스에 카메라를 붙이는 시도는 어리석은 접근이다. 사용자들은 그것으로 인해 얻을 수 있는 이점보다 해킹 등에 노출되었을 때의 위험성에 대해 더 신경을 쓰기 때문이다. 과거 TV에 카메라가 붙어서 나온적이 있었다. 대화면 영상 통화, 이벤트 녹화 등 상당한 이점이 있었음에도 프라이버시에 대한 논란으로 금방 사라져버린 제품군이 되었다. 하물며 얼굴인식으로 유용할지 아닐지 확실하지도 않은 개인화된 경험을 주는 정도의 이득을 위해 카메라를 붙이는 것이 과연 시장에서 메리트로 다가올지 모르겠다. 그것도 여기저기서 항상 해킹이 이루어지는 안드로이드를 운영체제로 사용하기에 우려는 더욱 크다. 제아무리 얼굴인식 데이터를 인터넷으로 전송하지 않는다고 하더라도 기기는 인터넷에 항상 연결되어 있기에, 해킹되는 순간 그 데이터가 노출되는 것은 당연하다.

Software

Android Q

Android Q will be soon available on multiple vendors 소프트웨어 측면에서 여러가지 특징들이 소개되었지만, 가장 중요한 발표는 안드로이드의 차기 버전인 Q버전에 대한 발표였다. 새 안드로이드 버전의 여러 특징들 중 인상 깊은 특징들은 다음과 같다.

Feature Description Foldable device support 삼성전자의 Galaxy Fold와 향후 나올 Foldable 기기를 공식 지원

서로다른 비율과 해상도를 가진 두 개의 화면이 존재하는 폴더블폰이 지원된다. 화면의 전환 시점 등 필요한 처리를 앱에서 해야할 부분이 있을 것으로 보이고, 이에 대한 프레임워크 지원이 예상된다.

5G support 5G 통신 지원

5G는 기본적으로 제조사가 지원해야 될 것으로 보이나, 관련된 기능에 대한 접근을 Android Framework에서 할 수 있을 것으로 보인다.

Live Caption 비디오 클립에 라이브 자막 기능 제공

청각 장애인을 위한 기능으로 유투브의 자막 기능과 같은 기능이 안드로이드에 탑재된다. 기기에서 재생되는 영상에 자막을 출력할 수 있다.

Native Dark Theme 어두운 톤의 테마 제공

순정 안드로이드에서 어두운 톤의 테마가 제공된다. 사용자들은 보통 제조사의 테마를 사용하므로 Pixel폰에서 의미있는 기능일 것으로 보인다.

Security Patch w/o reboot 재부팅 없는 보안 패치 적용

안드로이드를 업데이트 할 때, 보안 패치를 적용하기 위해서는 시스템이 재부팅되었다. Q버전부터는 재부팅 없이 보안 패치를 적용 가능하다.

Focus Mode 앱의 알림을 끌 수 있는 기능

사용자가 설정하는 특정 앱의 노티를 끄는 기능이다. 퇴근 후 회사의 이메일 노티를 받지 않는 등의 시나리오에서 사용이 가능할 것으로 보인다.

Family Link 자녀 보호 기능

자녀가 사용하는 스마트폰의 사용 시간이나 여타 다른 행위들을 부모가 컨트롤 할 수 있는 기능이다. 비슷한 기능을 하는 3rd Party 앱들이 많이 나와 있어서 큰 의미는 없을 것 같다.

전반적으로 개선이 된 점들이 보이지만, 폴더블 폰 지원을 제외하면 아주 큰 변화는 없을 것 같다. Q 버전은 곧 여러 안드로이드폰 제조사에 의해 다양한 기기에 적용될 예정이다.

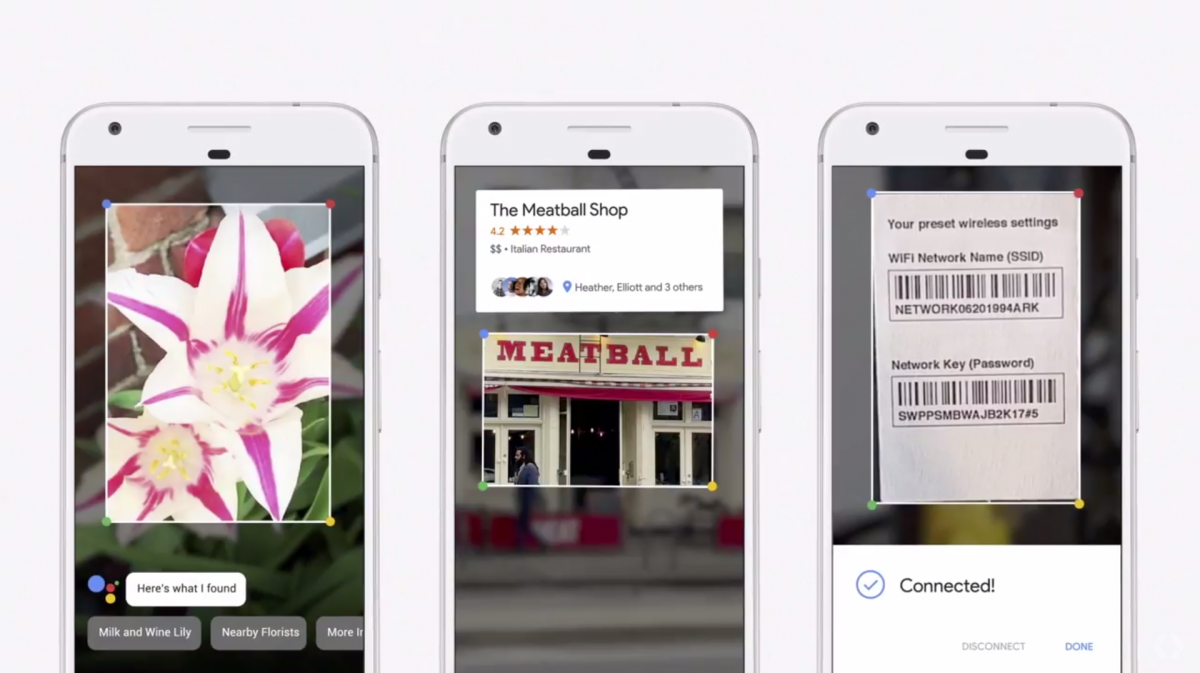

Google Lens

Google Lens Google Lens는 영상인식을 활용하여 사용자에게 유용한 기능을 제공하는 서비스이다. 예시에 나오는 것처럼 꽃을 찍으면 꽃의 정보를 띄워준다거나, 레스토랑의 간판을 찍으면 해당 레스토랑의 음식 메뉴와 가격 등의 정보를 제공한다. 음식 메뉴가 외국어로 되어있을 경우에는 번역까지 지원을 해준다. 또, 와이파이 정보가 담긴 태그를 찍으면 해당 와이파이에 자동으로 연결시켜 준다거나, 레스토랑의 요금 청구서를 찍으면 팁이나 더치페이 액수를 계산해 주는 예시도 소개되었다.

서비스 자체의 가치는 상당히 높을 것으로 기대된다. 카메라로 촬영을 하는 직관적인 행위 뒤에 그 사진에 대한 추가적인 정보나 서비스를 연결해 주는 것은 일상생활에서 효용가치가 높아 보인다. 영상인식의 정확도와 AI의 정확도 등 여러 변수가 있기는 하지만, 서비스 시나리오를 좁혀서 접근하면 훌륭한 기능이 될 것으로 판단된다.

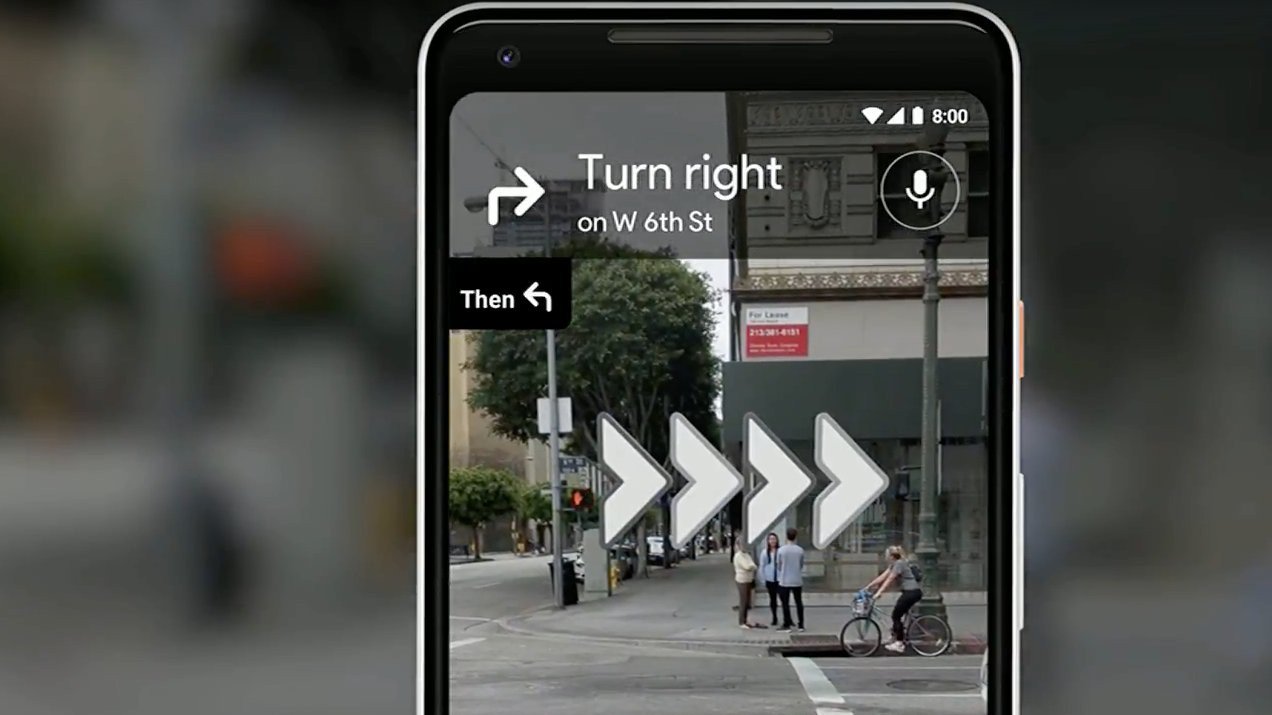

AR walking direction in Google map

No more dots. Arrowes over actual street view 구글맵의 네비게이션 기능이 한 단계 더 올라간다. 기존 네비게이션 서비스는 2차원의 지도상에 표시된 건물 이름, 길 이름, 방향 정보로 길을 안내했었다. 3차원 표시 기능이 있기도 했지만 도형으로 이루어진 경우가 많아 실제 거리의 풍경과 일치하지는 않았다. 구글은 스트리트뷰를 이용해 스트리트뷰 위에 네비게이션을 표시하는 혁신적인 방향성을 소개했다.

개인적으로 발표된 기능들 중 가장 현실성이 높고 기술 장벽도 낮은 기능이라 생각된다. 게다가 사용빈도가 높은 네비게이션을 개선하는 기능이어서 사용자 입장에서의 효용가치가 뛰어나다. 이미 축적된 스트리트뷰 데이터가 충분한 구글이기에 가능한 서비스일지 모르지만, 사용자 입장에서는 네비게이션의 혁명으로 비추어질 기능이다. 아마도 향후 많은 네비게이션 앱들이 이와 비슷한 기능을 도입하기 위해 노력하지 않을까 한다. 엄청난 개발 리소스를 투입했지만 정작 실생활에 크게 도움이 되지도 않는 AI 비서보다 훨씬 더 큰 가치를 창출할 것이다.

Offline Google Assistant

Google Assistant Google Assistant와 관련해서 가장 흥미로운 발표는 오프라인 기능의 지원이다. 얼마전까지도 딥러닝 기반의 AI가 마치 마법의 지팡이처럼 모든 상황을 해결해 줄 것으로 기대를 하고는 했다. 하지만 그 이면에 있는 엄청난 양의 러닝 데이터 사이즈에 대해서는 크게 고려가 되지 않았었다. 대부분의 AI는 서버 기반으로 작동했고, 대용량으 러닝 데이터는 서버에 저장되기 때문이었다. 그러나 이러한 서버 중심 모델은 클라이언트 기기의 스토리지를 절약할 수 있다는 장점 이외에 단점도 많이 가지고 있다. 우선 AI 사용을 위해서 클라이언트 기기는 항상 서버에 연결이 되어 있어야 한다. 오프라인 상황에서는 AI를 사용할 수 없는 것이다. 그리고 서버에 질의를 하고 그 응답을 기다려야 하기에 네트워크 상황에 따라 응답의 속도가 떨어지는 경우가 나타나곤 했다. 또한 익명 정보로 처리된다고는 하지만 사용자의 데이터가 서버로 전송이 되어야 한다는 점에서 프라이버시 이슈가 항상 있어 왔다.

서버 중심 AI의 대안으로 나온 것이 On-Device AI이다. 쉽게 생각해서 서버에서 이루어지던 딥러닝 연산을 클라이언트 기기에서 수행하는 모델이다. 최근의 스마트폰들은 대부분 머신 러닝 처리를 담당하는 전용 하드웨어 칩을 장착하는 경우가 늘어나고 있기에 생각해 볼만한 대안이다. 이 경우 인터넷 연결이 없어도 AI 사용이 가능하고, 빠른 응답 속도를 보이며, 프라이버시 이슈에서 자유로울 수 있다는 장점이 있다. 하지만 반대급부로 커다란 용량의 러닝 데이터를 클라이언트 기기에 가지고 있어야 한다는 점이 단점으로 대두된다. 한 예로 아주 단순한 게임을 클리어하기 위한 러닝 데이터가 몇 기가 단위로 올라가는 케이스도 있기에 범용적인 AI 사용을 위해서는 훨씬 더 큰 저장공간이 요구될 것이다.

구글은 Google Assistant의 오프라인 기능이 단지 500메가의 저장공간을 활용하여 지원될 수 있다고 말한다. 사용자의 다양한 케이스의 음성 명령을 인지하는데 단지 500메가의 저장공간을 쓰는 것이다. Google Assistant를 사용하는 다양한 사용자 시나리오와 원론적인 형태의 딥러닝 구현을 고려한다면 구글의 이 주장은 전혀 근거 없는 이야기이다. 컨퍼런스에서 발표되는 소프트웨어 기능들은 대부분 과장이 되어 있지만 그래도 최소한의 근거는 가지고 있다는 상식선에서 유추해 보면 구글은 아마도 특정 사용자가 자주 사용하는 Assistant 기능 위주의 러닝 데이터를 저장할 것으로 보인다. 나머지 엣지 케이스들은 애플의 시리와 비슷한 룰베이스로 처리하지 않을까 하는 추정을 해본다.

Duplex on the web

Duplex from Google I/O 2018 2018년 Google I/O에서 가장 화제가 되었던 기능이 바로 Duplex이다. 시연에서 사용자를 대신해서 피자집에 전화를 건 Duplex는 수화기 건너편의 사람에게 전혀 들키지 않고 마치 사람처럼 피자를 주문하는데 성공한다. 음성인식, TTS, 딥러닝, 제한된 피자 주문 시나리오라는 키워드들을 결합하면 개발자 입장에서 크게 놀라운 기술은 아니었지만 대중들에게 충격을 주기에는 충분한 시연이었다.

그런데 충격을 받은 대중들은 과연 Duplex에 대해 환호하였는가? 너무나 바빠서 2분도 걸리지 않는 피자 주문을 AI에게 맡겨야 하는 상황은 인생에 그리 많지 않다. 대중들이 느낀 것은 Duplex의 효용이 아니라 공포였다. "Creepy" 그리고 "Scary" 이것들은 Duplex와 연관된 키워드들이다. 2018년 시점을 돌이켜보면 기술에 대한 지식이 있는 개발자이기에 개인적인 감상은 공포와는 거리가 멀었지만, Duplex를 활용한 다양한 범죄 시나리오가 수십가지 머리속을 스쳐갔었다. 보이스피싱의 혁명...

Duplex from Google I/O 2019 구글도 이러한 사용자들의 반응을 충분히 인지한 것으로 보인다. 2019년 Google I/O에서 구글이 소개한 Duplex는 웹기반이었다. 사람에게 전화를 거는 것이 아니라 웹페이지에 대한 개인정보 입력을 대신해주는 기능으로서 Duplex가 소개된다. 실제적인 사용 예시로는 다음과 같은 상황을 들 수 있다. Google Assistant를 통해 내일 저녁 어벤저스 영화표를 예매하라는 명령을 내리면, Duplex는 영화예매 사이트에 접속하여 내일 저녁 어벤저스 영화를 검색하고 이미 저장된 사용자의 개인정보를 이용해 예매 페이지의 입력 내용을 자동으로 채워 제출한다. 결과적으로 사용자는 한 문장의 음성 명령으로 원하는 영화표를 예매할 수 있게 된다.

음성인식 대신 더 쉬운 Text 인식이 들어가고, TTS가 빠졌을 뿐 2018년의 시연과 동일한 기술이다. 하지만 사용자의 심리적인 저항감은 훨씬 적게 느껴진다. 이 시나리오에서는 2018년 시연의 대상이었던 실제 사람인 피자집 직원이 없기 때문이다.

사실 개발자 입장에서 보면 문제는 그대로 남아있다. 누군가 폰을 해킹한다면 Duplex에 저장된 광범위한 사용 시나리오와 사용자의 개인정보를 활용해 하고싶은 일들을 마음대로 할 수 있는 것이다. 영화표를 예약할 수 있다면, 물건을 사거나, 송금을 하는 시나리오도 얼마든지 가능하다. 사실 2018년 Duplex 시연을 보았을 때보다 더 큰 범죄 시나리오가 머리속을 스쳐 지나간다. 보이스 피싱과 같은 소셜 어택이나 소프트웨어적인 해킹으로 피해자의 스마트폰 접근 권한을 얻었다고 가정하자. 이제 공격자는 Duplex를 활용한 다양한 일을 수행할 수 있다. 피해자의 계좌 잔고를 소진해 비트코인을 구매하고 비실명 이메일로 전송하면 어떨까? 금융 사기에서 가장 어려운 부분인 대포 통장을 통한 현금화 과정을 한 번에 바이패스할 수 있는 사기의 혁명...

Fin.

반응형'Analysis' 카테고리의 다른 글

미국의 화웨이 제재 의미와 해석 (5G-Google-ARM) (0) 2019.05.25 인텔 프로세서의 보안 결함 좀비로드(ZombieLoad aka MDS) 분석 (0) 2019.05.15 Google Stadia 분석: Future(전망)편 (2) 2019.05.10 Google Stadia 분석: Ecosystem(생태계)편 (0) 2019.05.10